Meta智能眼镜新推出的实时翻译效果依然参差不齐

计划在今年重点关注一下AI+眼镜这个火热的方向,会实时跟进这个领域的一些海外最新报道和文章,今天先带来下面这篇关于Meta Ray-Ban的AI实时翻译能力的评测文章。如果对AI眼镜感兴趣的朋友欢迎关注我的公众号【檬查查】和视频号【RichChat檬查查】

Meta智能眼镜新推出的实时翻译效果依然参差不齐

- 我与一位西班牙语使用者对话并尝试观看Emilia Pérez(一部西语电影)的视频片段,结果出现了有趣的差异。

我上一次上西班牙语课还是在初中时期。我只记得一些很基础的短语,比如”洗手间在哪里?”和”我的猫很胖”这样的表达。如果没有翻译工具,要用西班牙语进行有意义的对话是不可能的。所以当我前几天通过Ray-Ban Meta智能眼镜,能够与一位西班牙语使用者进行关于K-pop的基本对话时,我真的感到很惊讶。

实时翻译功能是上个月功能更新的一部分,与实时AI和Shazam(智能识别歌曲)一起推出。这个功能就像它听起来那样简单 - 当你打开这个功能时,你可以与说西班牙语、法语或意大利语的人进行对话,眼镜会将对方说的话实时翻译并通过耳机播放。你还可以在手机上查看对话记录。你用英语说的话也会被翻译成对方的语言。

坦白说,我的对话是Meta安排的演示的一部分。这与你真的戴着这副眼镜去巴塞罗那实地使用是不同的。话虽如此,作为一个翻译技术怀疑论者,我打算找出这项技术可能失效的所有漏洞。

这副眼镜在翻译关于K-pop乐队的基本对话时表现不错。在我的对话伙伴说完话后,翻译很快就会开始。如果我们用适中的语速交谈,每次只说几句话,效果就很好。但这并不是人们实际说话的方式。在现实生活中,我们会滔滔不绝地讲话,会突然想不起来要说什么,在生气或兴奋时会说得更快。

值得称赞的是,Meta考虑到了这些情况。我让对话伙伴说得更快,说得更长。它对付快速语速的表现还不错,虽然实时记录确实会有一些可以理解的延迟。对于较长的发言,眼镜会在对方说话还没结束时就开始翻译。这有点令人不适应,因为作为听众,你需要意识到自己落后了一些 - 这种体验类似于国际新闻或广播中的实时人工口译。

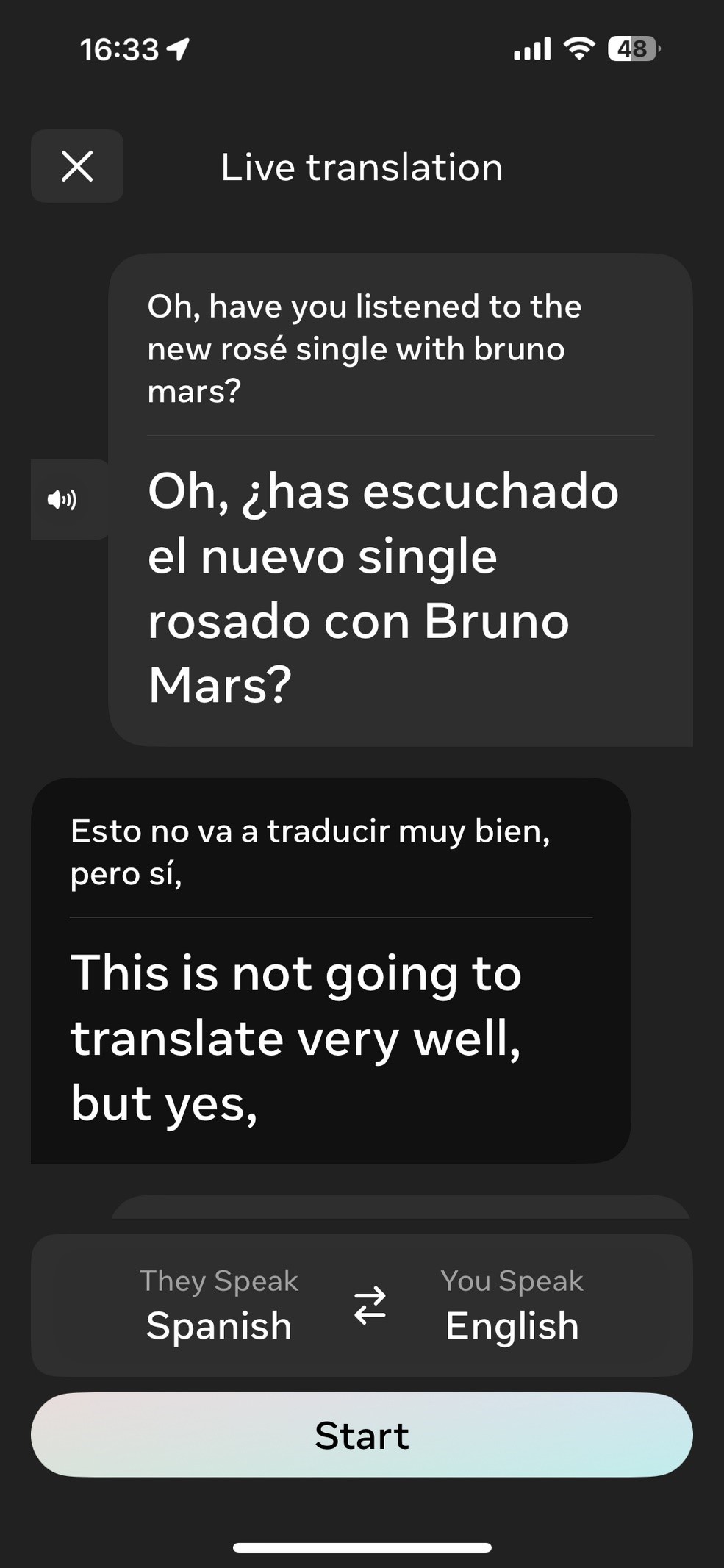

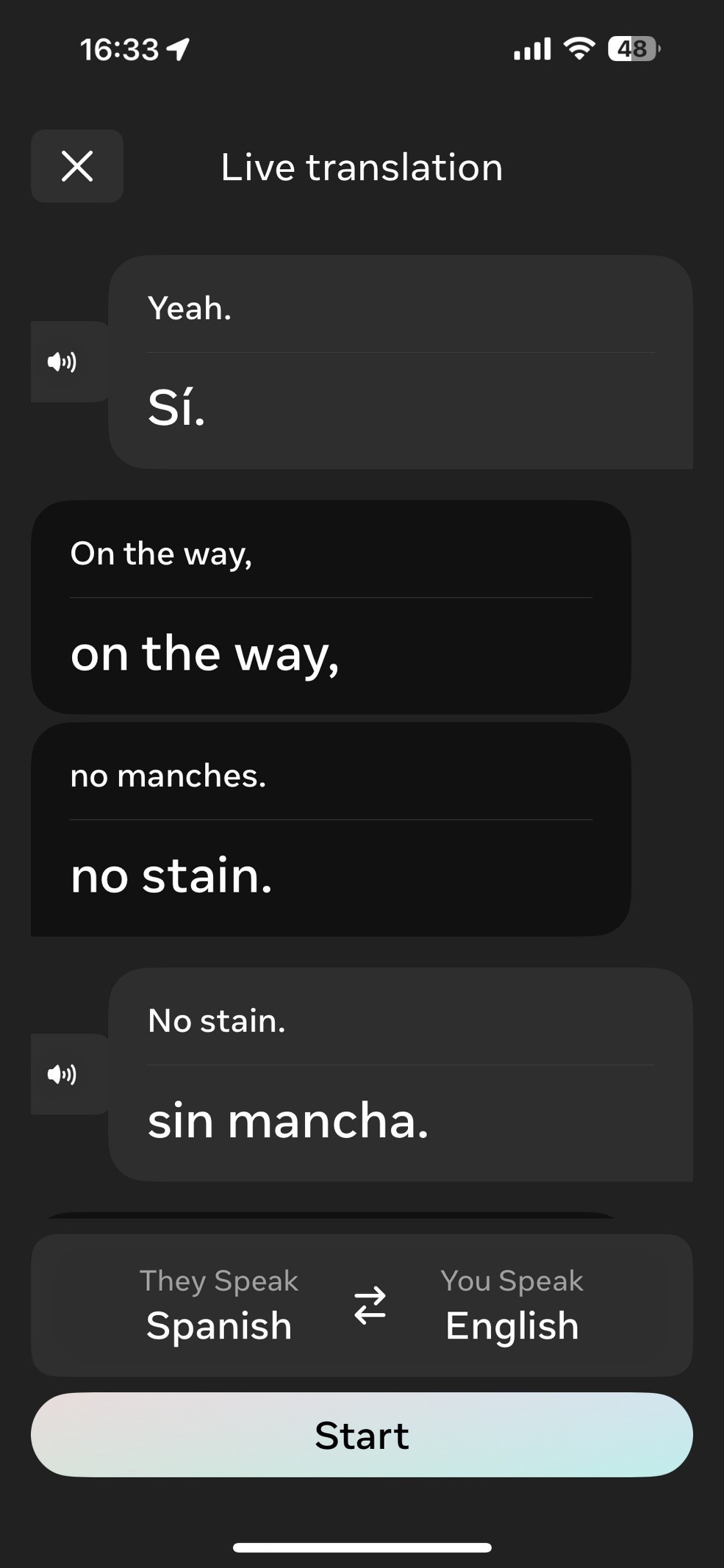

最让我印象深刻的是眼镜能够处理一些Spanglish(西班牙语和英语混合使用)。通常,多语言使用者很少严格地只用一种语言,特别是在使用混合语言的场合。在我的家庭里,我们称之为Konglish(韩语和英语的混合),人们会在两种语言之间自然切换,混合使用语法,看似混乱却很实用。例如,我的姑妈经常会说几句韩语,然后插入两句英语,再说一句韩英混合的话,然后又回到韩语。我让我的对话伙伴尝试用西班牙语做类似的尝试…结果好坏参半。

一方面,眼镜能够处理短暂的语言切换。然而,当说较长的英语内容时,AI会在我耳边重复英语内容。有时候,它还会重复我说过的话,因为它开始混淆了。这变得非常分散注意力,以至于我无法专注于正在说的内容。

眼镜在处理俚语时遇到了困难。每种语言都有其方言,每种方言都有其独特的口语表达方式。就像美国青少年给我们带来”skibidi”和”rizz”这样的词汇一样。在这个例子中,眼镜无法准确翻译”no manches”。这个词直译是”别弄脏”,但在墨西哥西班牙语中,它也表示”不会吧”或”你在开玩笑吧!”眼镜选择了字面翻译。从这个角度来看,翻译是一门艺术。在某些情况下,眼镜能够传达正确的大意,但未能捕捉到对我说的话中的一些细微差别。这是所有翻译者——无论是AI还是人类——都面临的困扰。

你不能用这个来看没有字幕的外语电影或电视节目。我看了几段《Emilia Pérez》的片段,虽然它能准确翻译人物大声清晰说话的场景,但在人物快速低声耳语的场景中就失效了。至于电影中的音乐部分,就完全别想了。

如果你只用于Meta设计这个功能的初衷,你就不会遇到这些问题。很明显,这些眼镜主要是为了帮助人们在访问其他国家时进行基本交流——比如问路、在餐厅点餐、参观博物馆或完成交易。在这些情况下,你更可能遇到理解你不是母语者而说话较慢的人。

这是一个好的开始,但我仍然梦想着道格拉斯·亚当斯的《银河系漫游指南》中的翻译鱼——一种小生物,当它被放入耳朵时,可以立即准确地将任何语言翻译成你的语言。

目前,这仍然只存在于科幻小说中。

英文原文链接:Live translations on Meta’s smart glasses work well — until they don’t